Kako AI roboti vplivajo na delovanje spletnih strani in trgovin?

9 min branja

Ste v zadnjem času opazili, da se vaša spletna stran občasno odziva počasneje? Ali da se stroški gostovanja spletne strani višajo, čeprav imate enako število obiskovalcev? Vzrok za to je morda presenetljiv in nima nič skupnega z vašimi pravimi obiskovalci.

Na spletu namreč poteka tiha revolucija, ki jo poganjajo avtomatizirani programi podjetij za umetno inteligenco. Ti tako imenovani AI roboti ali pajki (angleško crawlers oziroma scrapers) sistematično pregledujejo in kopirajo / povzemajo vsebine spletnih strani po celotnem internetu. Njihov namen je jasen: zbirati podatke za učenje velikih jezikovnih modelov, kot so ChatGPT, Gemini, Claude in drugi.

Težava? Teh robotov je vedno več, delujejo vse bolj agresivno, njihov vpliv na delovanje spletnih strani pa postaja vse bolj opazen. V tem članku bomo na podlagi najnovejših podatkov razložili, kaj se dogaja, kakšne so posledice za lastnike spletnih strani in kako se lahko zaščitite.

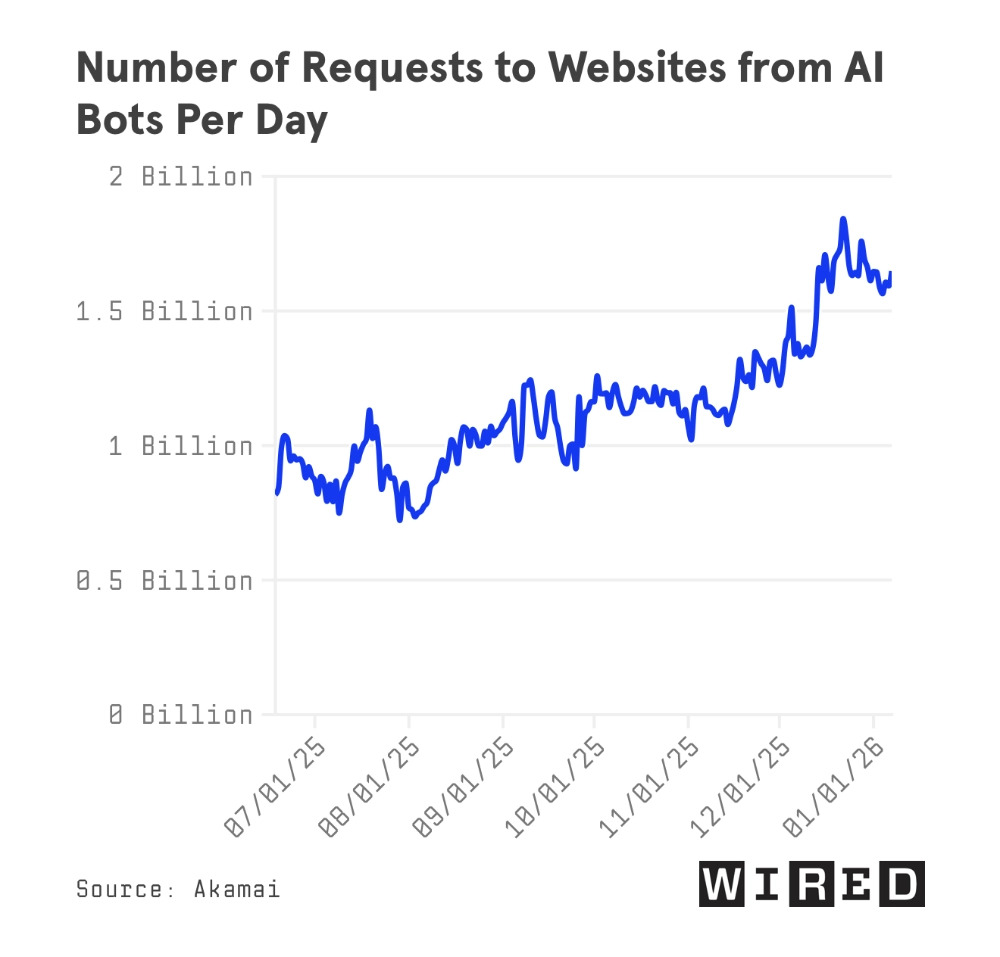

Promet AI robotov narašča eksponentno

Podjetje Akamai, ki upravlja eno največjih infrastrukturnih omrežij na svetu in skozi katerega teče več kot tretjina svetovnega spletnega prometa, je v svojem poročilu Digital Fraud and Abuse Report 2025 razkrilo zaskrbljujoče trende. Promet, ki ga ustvarjajo AI roboti, se je v zadnjem letu povečal za 300 odstotkov. Ti roboti dnevno ustvarijo več kot milijardo zahtevkov na spletne strani po celotnem svetu.

Po podatkih podjetja TollBit, ki spremlja aktivnost povzemanja podatkov spletnih strani, je v zadnjem četrtletju leta 2025 že vsak petdeseti obisk spletne strani izviral od AI robota. Še v prvem četrtletju istega leta je bilo to razmerje en na dvesto. Gre za štirikratno povečanje v manj kot enem letu.

Posebno zaskrbljujoče je, da več kot 13 odstotkov zahtevkov AI robotov namerno zaobide datoteko robots.txt, torej mehanizem, s katerim lastniki spletnih strani določijo, katerih delov spletišča roboti ne smejo pregledovati. Delež robotov, ki ignorirajo ta navodila, se je v drugi polovici leta 2025 povečal za 400 odstotkov.

Kaj to pomeni za vašo spletno stran?

Za povprečnega lastnika spletne strani ali spletne trgovine ima množičen obisk AI robotov več neposrednih posledic.

- Upočasnitev in izpadi. AI roboti oddajajo ogromno število zahtevkov v kratkem času. Če vaš strežnik ni pripravljen za tako obremenitev, se stran začne odzivati počasi, ali pa postane povsem nedostopna. Medij openDemocracy je na primer poročal, da je bila njihova spletna stran večkrat povsem nedostopna zaradi agresivnega strganja s strani AI podjetij. Podobne izkušnje so opisali tudi pri odprtokodnem projektu OpenStreetMap, kjer so AI roboti povzročili konstantno preobremenjenost strežnikov.

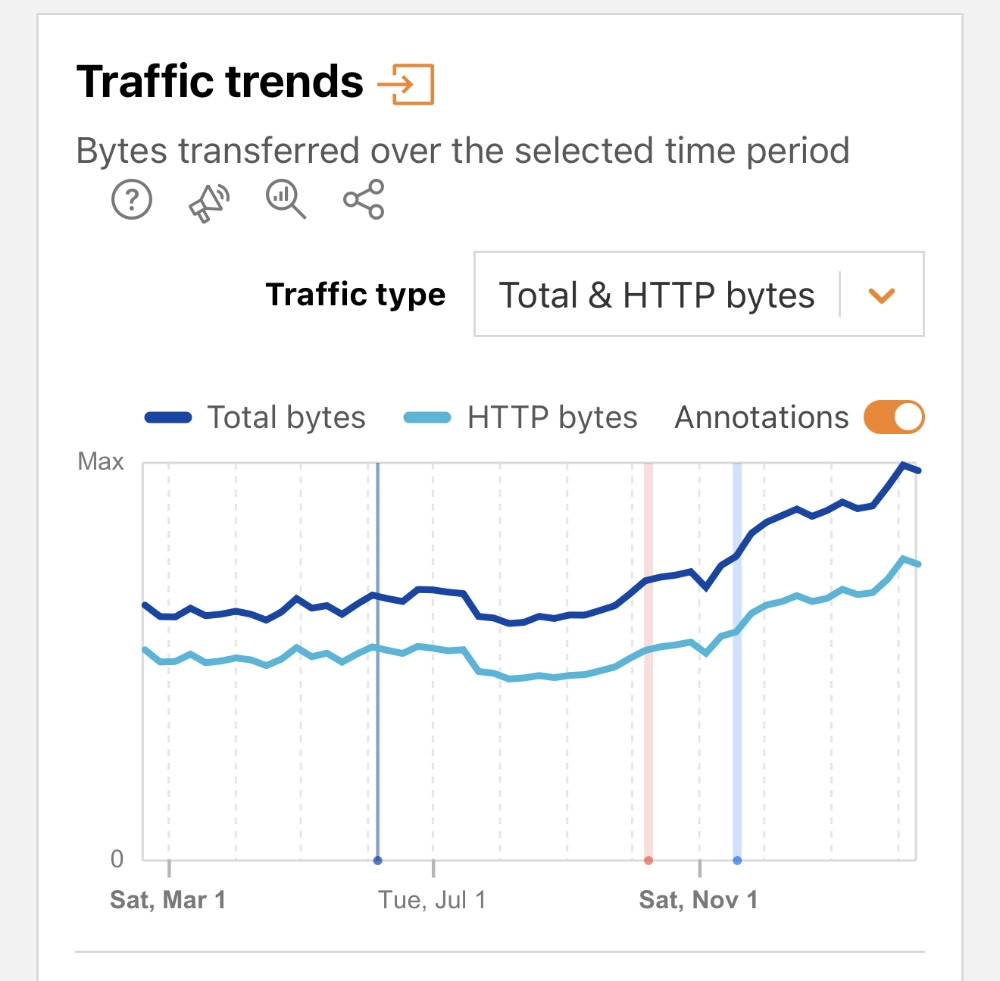

- Višji stroški gostovanja. Vsak zahtevek na vašo spletno stran pomeni obremenitev procesorja, pomnilnika in pasovne širine. Več zahtevkov pomeni višje stroške, tudi če vaši pravi uporabniki niso nič bolj aktivni. Kot smo že pisali v članku o naraščajočih stroških gostovanja, je ta pojav eden od skritih razlogov, zakaj so računi za strežniške storitve vse višji. Tudi na Kabi strežnikih to opažamo: kot bomo pokazali v nadaljevanju, naši varnostni sistemi tedensko zaznajo in blokirajo milijone poskusov nepooblaščenega dostopa in povzemanja podatkov.

- Popačena analitika. Kadar AI roboti obiskujejo vašo spletno stran, se ta promet pogosto zabeleži kot običajen obisk. Posledica so napačni statistični podatki, napihnjena števila ogledov strani, izkrivljene stopnje odboja in napačne stopnje konverzije. Na podlagi takšnih podatkov je nemogoče sprejemati pravilne poslovne odločitve.

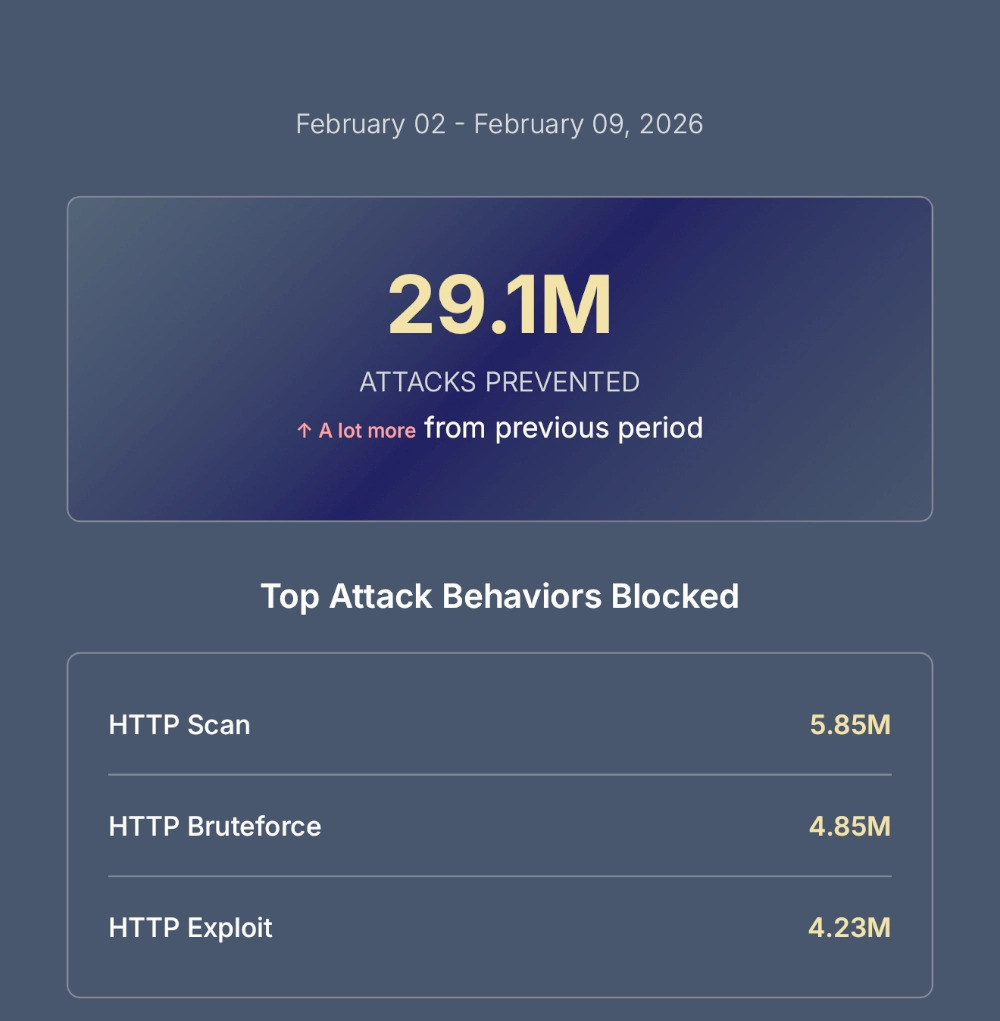

- Varnostna tveganja. AI roboti ne samo povzemajo vsebine, v nekaterih primerih predstavljajo tudi varnostno grožnjo. To vidimo tudi na lastni koži. Na Kabi strežnikih, kjer gostujemo spletne strani in trgovine naših strank, uporabljamo varnostni sistem, ki v realnem času zaznava in blokira sumljive aktivnosti. Podatki, ki jih beleži ta sistem, so zelo zgovorni.

Primerjava obeh tednov govori sama zase. V tednu od 2. do 9. februarja je sistem na Kabi strežnikih preprečil 29,1 milijona napadov. Že naslednji teden, od 9. do 16. februarja, pa se je ta številka povzpela na neverjetnih 536 milijonov. To je 18-kratno povečanje v enem samem tednu. Takšni skoki jasno kažejo, kako nepredvidljiva in intenzivna je lahko aktivnost avtomatiziranih robotov, zato je stalna zaščita in spremljanje prometa nujno.

Zakaj se to dogaja ravno zdaj?

Razlogov za tako hitro rast je več. Prvič, podjetja za umetno inteligenco tekmujejo med seboj, kdo bo svoje jezikovne modele učil na čim večji količini podatkov. Vsaka spletna stran z unikatno vsebino, bodisi članki, opisi izdelkov, strokovnimi nasveti ali uporabniškimi mnenji je za te modele dragocen vir podatkov. Drugič, poleg robotov za učenje modelov se širijo tudi tako imenovani iskalni ali pridobivalni roboti (retrieval bots), ki v realnem času pridobivajo informacije za odgovore AI orodij, kot sta ChatGPT ali Perplexity. Tretjič, tržišče za povzemanje / kopiranje spletnih vsebin izjemno raste. Podjetje TollBit je identificiralo že več kot 40 podjetij, ki ponujajo storitve povzemanja, prilagojene za AI namene.

Za spletne trgovine je ta trend še posebej občutljiv. AI roboti pogosto povzemajo celotne kataloge izdelkov, vključno s cenami, opisi in slikami. Te podatke lahko konkurenti uporabijo za samodejno prilagajanje svojih cen ali pa AI sistemi ponudijo uporabnikom povzetek informacij, ne da bi ti sploh obiskali vašo trgovino. Rezultat je enak: vaša vsebina dela za druge, vi pa nosite stroške ustvarjanja vsebin, vzdrževanje in ne nazadnje gostovanja.

Kako se zaščititi?

Čeprav popolna zaščita pred AI roboti ni možna, obstajajo učinkoviti ukrepi, s katerimi lahko bistveno zmanjšate njihov vpliv.

- Ustrezna datoteka robots.txt je prvi korak. Z njo lahko določite, katerim robotom dovolite dostop in katerim ne. Čeprav nekateri roboti ta navodila ignorirajo, večina večjih podjetij (Google, OpenAI, Anthropic) datoteko robots.txt spoštuje. Pomembno je, da jo redno posodabljate, saj se na trgu pojavljajo vedno novi roboti.

- Uporaba napredne požarne pregrade (WAF) in zaščite pred roboti je naslednji korak. Storitve, kot je Cloudflare, ponujajo možnost blokiranja AI robotov z enim klikom. Več kot 80 odstotkov Cloudflare strank se je že odločilo za blokado AI robotov, kar govori o resnosti problema. Podrobnosti o zaščitnih mehanizmih smo opisali v našem članku o zaščiti spletne strani.

- Spremljanje strežniških dnevnikov (logov) vam omogoča, da pravočasno zaznate neobičajno aktivnost. Bodite pozorni na nenavadne vzorce, kot so veliko zahtevkov z istih naslovov IP, ponavljajoče se dostope do istih podstrani ali neobičajno visoko zasedeno pasovno širino. Kot opozarjajo strokovnjaki, mnoga spletna mesta sploh ne vedo, da jih AI roboti povzemajo.

- Varnostni sistemi na ravni strežnika dodajo še en sloj zaščite. Na Kabi strežnikih uporabljamo varnostni sistem, ki deluje po principu skupnostne obveščenosti. Ko se na enem strežniku zazna grožnja, se ta informacija deli z vsemi drugimi uporabniki sistema, kar omogoča proaktivno blokiranje znanjih groženj, še preden dosežejo vašo spletno stran. Kot kažejo podatki iz naših poročil, ta sistem tedensko prepreči od deset do več sto milijonov poskusov nepooblaščenega dostopa.

- Profesionalno gostovanje in vzdrževanje je temelj zanesljivega delovanja. Strežnik, ki je pravilno nastavljen in redno vzdrževan, se bo obremenitvi AI robotov bolje uprl kot cenovno ugoden, a neoptimiziran gostovalni paket. O pomenu kakovostnega gostovanja in vzdrževanja smo pisali v članku o spletni varnosti.

Vse zgornje stvari pri Kabiju počnemo v sklopu vzdrževanja spletnih strani za naše stranke.

Prihodnost: oborožitvena tekma med spletnimi stranmi in roboti

Trendi so jasni, AI promet na spletu bo le še naraščal. Glavni tehnološki direktor podjetja Akamai je bil jasen: umetna inteligenca spreminja splet, kot ga poznamo. "Oborožitvena tekma" med spletnimi stranmi in roboti bo določila prihodnji videz in delovanje interneta. Medtem, ko se nekatera podjetja prilagajajo in iščejo modele, v katerih bi AI podjetja plačevala za dostop do vsebin, se večina lastnikov spletnih strani sooča s preprostim dejstvom: zaščita pred AI roboti postaja enako nujna kot zaščita pred zlonamerno programsko opremo.

Število spletnih mest, ki aktivno blokirajo AI robote, se je v zadnjem letu povečalo za 336 odstotkov. To jasno kaže, da se lastniki spletišč zavedajo problema. A hkrati se roboti razvijajo. Nekateri že posnemajo človeško vedenje pri brskanju, spreminjajo hitrost klikov in dolžino sej, da bi se izognili zaznavanju.

Zaključek: ne čakajte, da bo prepozno

AI roboti niso le abstraktna grožnja iz tehnoloških novic, so realnost, ki že danes vpliva na hitrost, stroške in varnost vaše spletne strani ali trgovine. Ne glede na to, ali upravljate spletno trgovino, podjetniško spletno stran ali informacijski portal, je čas za ukrepanje zdaj.

V podjetju Kabi se s temi izzivi ukvarjamo vsak dan. Z več kot 30 leti izkušenj na področju spletnih tehnologij smo priča evoluciji groženj iz prve roke. Naše storitve gostovanja in vzdrževanja spletnih strani vključujejo redno spremljanje prometa, nastavitve zaščitnih mehanizmov ter optimizacijo strežniške infrastrukture. Ker spletne rešitve razvijamo na lastni platformi, imamo nad delovanjem spletnih mest popoln nadzor in se lahko hitro odzovemo na nove grožnje. To je ena od ključnih prednosti lastnega sistema v primerjavi s odprtokodnimi platformami, kjer je varnostna odgovornost pogosto razpršena.

Vas zanima, kako je z AI prometom na vaši spletni strani? Kontaktirajte nas in skupaj bomo preverili stanje ter po potrebi uvedli ustrezne zaščitne ukrepe.

Viri in nadaljnje branje:

- Akamai: Digital Fraud and Abuse Report 2025

- Wired: AI Bots Are Now a Significant Source of Web Traffic (februar 2026)

- CrowdSec: Weekly Security Report (februar 2026), podatki za Kabi strežnike

- openDemocracy: AI Chatbot Attacks Could End the Internet as We Know It

- Cloudflare: AI Bot Insights in Radar Dashboard

- Kabi: Skrita grožnja za vašo spletno stran, zakaj so stroški gostovanja vse višji

- Kabi: Kako zaščititi svojo spletno stran

- Kabi: Zakaj je spletna varnost danes ključnega pomena